Zavraždili byste dítě? A co robotické?

Autor: Aneta Lesná (21. 2. 2014)

Ještě relativně nedávno byla myšlenka robotích práv na cokoli pouze tématem vědeckofantastických romanů. Důvodem mohla být relativní nesofistikovanost strojů okolo nás. Málokdo má problém zbavit se mikrovlnky nebo auta na dálkové ovládání. Socialní roboti jsou ale jiní. Projevují autonomní chování, jednají se zdánlivým rozmyslem a vzhledem připomínají známé věci, jako například domácí zvířata a humanoidy. Prostě se chovají... živě. To v lidech často vyvolává překvapivě silné emoce.

Kate Darling, výzkumnice MIT, provedla experiment - požádala lidi, aby si hráli s robotem Pleo. Pleo je dětská hračka, malý roztomilý dinosaurus. Je zelený a příjemný na dotek. Má důvěřivé oči a chová se přítulně. Po vybalení se chová jako bezbranné štěně. Neumí chodit a musíte mu ukázat svět. Po hodině, kdy účastníci dinosaury lechtali a mazlili se s nimi, jim K. Darling dala nože, sekerky a jiné zbraně a nařídila jim hračky mučit a zničit. Jejich reakce (účastníků, ne hraček) byla "dramatičtější, než vědci kdy čekali".

Lidské reakce na krutost vůči robotům jsou důležité, protože nedávný vývoj v oblasti robotiky nás nutí přehodnotit svůj vztah ke strojům. Když minulý rok v Bostonu K. Darling experiment s dinosaury popisovala, naznačila, že špatné zacházení s určitými typy robotů by se brzy mohlo stát v očích společnosti nepřijatelným. Dokonce věří, že možná budeme potřebovat soubor "robotích práv". Pokud ano, kdy by například bylo v pořádku zavraždit robota?

Vystrašená Furby a nelidské mučení robota

V jiném experimentu Freedom Baird z MIT požádal děti, aby držely hlavou dolů panenku Barbie, křečka a robota Furby, dokud jim to nebude nepříjemné. Panenku držely, dokud je nebolely ruce, ale brzy přestaly trápit svíjejícího se křečka. Po chvíli i robota. Byly dost staré, aby věděly, že Furby je hračka, ale nemohly vydržet to, jak neustále opakovala "Me scared".

Překvapivě silná pouta ale s roboty netvoří jen děti. Někteří lidé dávají jména svým vysavačům Roomba. Vojáci udělují robotům "medaile" a strojí jim pohřby. K. Darling uvádí obzvlášť zajímavý případ vojenského robota určeného ke zneškodňování bomb zašlápnutím. Během testu mu exploze utrhaly téměř všechny nohy, ale zchromený stroj se stále plazil. Při pohledu na robotovo utrpení velící plukovník test ukončil, protože ho považoval za "nelidský".

Výzkumníci z Universität Duisburg-Essen v Německu použili v experimentu fMRI skener a přístroje měřící vodivost kůže, aby zaznamenali lidské reakce na video, kde někdo mučí dinosaura Pleo, škrtí ho, zavírá do igelitové tašky nebo ho mlátí. Naměřené fyziologické a emocionalní reakce několikanásobně předčily očekávání, přestože účastnící věděli, že se dívají na robota.

Podobně ostatně dopadl i experiment Kate Darling. Po hodině hraní lidé odmítli použít na svou hračku zbraně, které dostali. Odmítli také zabít jiného dinosaura, aby zachránili svého. Nakonec bylo účastníkům řečeno, že pokud někdo nezabije jednoho dinosaura, všichni roboti budou utraceni. Po dlouhém váhání jeden muž odmítavě předstoupil se sekerkou a praštil do jedné z hraček. Potom místnost na několik sekund ztichla. Vypadalo to, že účastníky síla jejich reakce překvapila.

Ochrana robotů i lidstva

Robotici v Evropě už před několika lety navrhovali vytvoření souboru etických pravidel pro výrobu robotů. Mělo jít o adaptaci Asimovových zákonů robotiky pro naši dobu. Jedním z jejich pěti pravidel bylo, že roboti "by neměli být navrhováni klamným způsobem" a "jejich strojový základ musí být průhledný". Prostě musí být způsob, jak zlomit iluzi emocí a rozmyslu a vidět robota jako robota.

K. Darling ale věří, že bychom mohli zajít i dál. Možná budeme muset chránit práva robotů zákony. Důvodem nemusí být jen "utrpení" robota. V jisté chvíli může být samotné násilí (nikoli jeho následky) to, co nelze tolerovat.

Samozřejmě, že následky pro oběť nejsou vždy jediným důvodem pro zakázání technologie. Nedávno například Britská lékařská asociace tvrdila, že kouření e-cigaret na veřejnosti by mělo být zakázáno. Přestože nepředstavuje pro nikoho v okolí zdravotní hrozbu, normalizuje prý klasické kouření na veřejnosti. Pokud tedy otec mučí robota před čtyřletým dítětem, je to přijatelné? Děti nemají chápání dospělých a mučení robota je může naučit, že náslilí je za určitých okolností v pořádku.

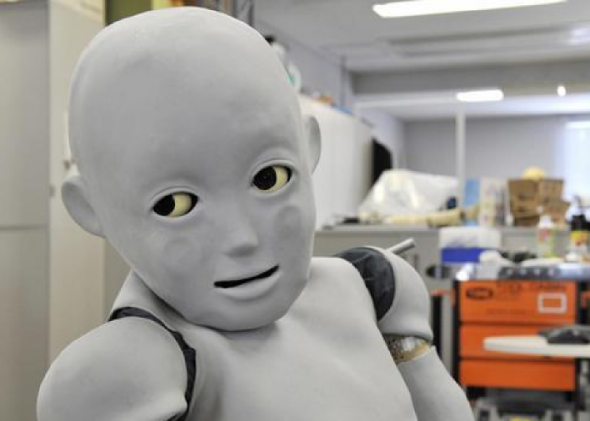

Pojďme do extrému. V laboratořích jsou dnes vyvíjeni relativně realističtí dětem podobní roboti. Co kdyby někdo jednoho z nich prodal pedofilovi planujícímu proměnit své nejtemnější sny ve skutečnost? Měla by to společnost dovolit?

Existuje více příkladů "zla bez obětí". Relativně nedávno New Yorker popsal moralní dilema, které vzniklo, když se na diskuzním foru o Grand Theft Auto objevila otázka, zda je znásilnění ve hře přijatelné. Tazatel mimo jiné napsal: "Chci mít možnost unést ženu, věznit ji, držet ji ve svém sklepě a každý den ji znásilňovat, poslouchat její pláč a vidět její slzy." Kdyby tohle mohl provést s humanoidním robotem simulujícím oběť, mohlo by být těžké to tolerovat.

Existuje ještě jedna možnost. Roboti by skutečně mohli trpět. Někteří výzkummníci už začali s pokusy "dát robotům bolest". Samozřejmě se nabízí otázka, zda tento svět potřebuje více bolesti.

Roboti v sobě nepochybně mají určité spektrum "živosti". Je ale možné definovat, jak přesně se s nimi nesmí zacházet? Nebo co přesně musí robot splnit, aby se s ním jistým způsobem nesmělo zacházet? A měli bychom se o to pokoušet?

Komentáře